Сегодня искусственный интеллект (ИИ) глубоко внедрился в корпоративные процессы. Компании используют нейросети для автоматизации маркетинга, скоринга кандидатов, генерации контрактов и клиентской поддержки. Однако эпоха «дикого запада» в сфере ИИ в Европе официально завершилась.

Принятый Европейским союзом регламент AI Act (Закон об искусственном интеллекте) вступил в фазу активного применения. Это первый в мире масштабный свод правил, который превращает ИИ из зоны технологического творчества в зону строгого юридического контроля.

В этой статье мы разберем, как закон влияет на бизнес, какие системы ИИ попали под удар и как избежать колоссальных штрафов.

Существует опасное заблуждение, что Закон об ИИ регулирует только IT-гигантов вроде OpenAI или Google. Это не так. Закон распространяется на любую компанию, которая внедряет ИИ-решения на рынке ЕС или если результаты работы ИИ используются в Европе.

Даже если вы не пишете код, а просто купили готовый софт, вы являетесь «пользователем» (deployer) и несете ответственность. Риски возникают, если ваш бизнес использует ИИ для:

Скрининга резюме, оценки кандидатов и HR-аналитики;

Автоматического скоринга клиентов и оценки кредитоспособности;

Анализа юридических документов и генерации договоров (Legal Tech);

Обработки клиентских запросов через умные чат-боты.

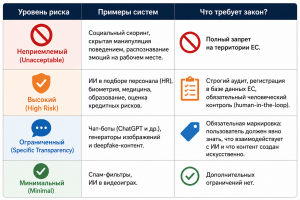

В основе AI Act лежит риск-ориентированный подход. Чем опаснее сфера применения ИИ для прав человека, тем жестче требования.

Серьезная уязвимость для бизнеса сегодня — это «теневой ИИ» (Shadow AI), когда сотрудники без ведома руководства загружают конфиденциальные данные в публичные нейросети.

Вводя в строку запроса текст коммерческого договора, персональные данные клиентов или финансовые отчеты для суммаризации, компания автоматически нарушает не только AI Act, но и жесткий регламент GDPR. Любая утечка данных через ИИ-модели может повлечь за собой двойные штрафы со стороны европейских регуляторов.

Важно: Использование ИИ требует немедленного пересмотра корпоративной политики конфиденциальности (Privacy Policy) и внедрения внутренних регламентов (AI Governance).

Рынок ИИ-помощников для юристов растет, но реклама таких сервисов теперь требует осторожности. ИИ не имеет лицензии адвоката и склонен к «галлюцинациям» (выдумыванию фактов).

Если ваша платформа помогает автоматизировать юридические процессы, избегайте триггерных фраз в маркетинге:

❌ «ИИ полностью заменяет юриста»

❌ «Гарантированная юридическая чистота от нашего ИИ»

❌ «Финальное юридическое заключение за 1 минуту»

Вместо этого позиционируйте продукт как инструмент для повышения эффективности человека, оставляя финальное решение за квалифицированным специалистом.

Санкции за несоблюдение нового регламента ЕС дифференцированы и могут стать фатальными для бизнеса:

До €35 млн или 7% от мирового оборота — за использование запрещенных систем ИИ.

До €15 млн или 3% от мирового оборота — за нарушение требований к ИИ-системам высокого риска.

До €7.5 млн или 1% от оборота — за предоставление неверной или вводящей в заблуждение информации регуляторам.

Чтобы минимизировать юридические риски, компаниям рекомендуется предпринять пять последовательных шагов:

Проведите аудит ИИ (AI Mapping): Составьте карту всех ИИ-инструментов, используемых в компании, и определите их класс риска.

Разработайте AI Policy: Внедрите внутренние правила для сотрудников — четко пропишите, какие данные можно загружать в ИИ, а какие категорически запрещено.

Обеспечьте контроль человека: Пересмотрите процессы автоматического принятия решений (особенно в HR и финансах). Убедитесь, что финальное слово остается за человеком.

Обновите договоры (Data Processing Agreements): Если вы используете сторонние ИИ-сервисы, проверьте их контракты на соответствие стандартам ЕС и GDPR.

Обучите команду: Проведите тренинги по цифровой гигиене и безопасной работе с генеративным ИИ.

Искусственный интеллект остается мощным драйвером роста, но теперь его использование требует стратегического юридического подхода. Комплаенс с AI Act — это не просто защита от штрафов, но и конкурентное преимущество на европейском рынке.